[服务开发团队,Yeji Jo]

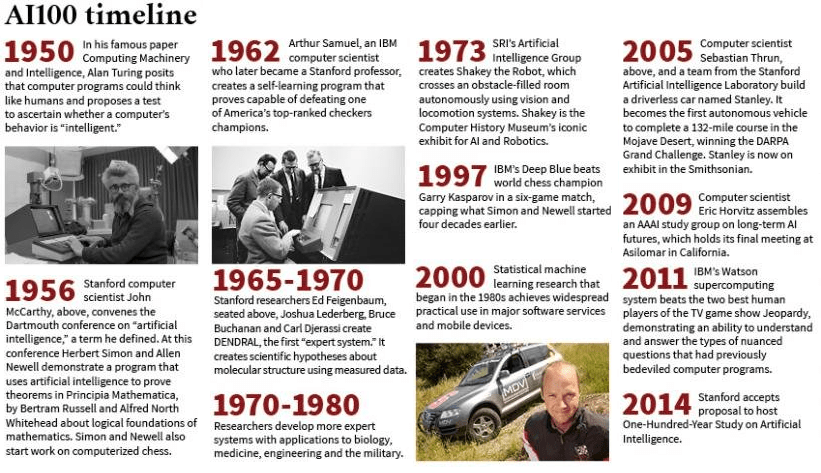

美国人工智能促进协会 (AAAI) 前任主席 Eric Horvitz 博士和斯坦福大学的计算机科学家,AI100(百年研究)研究了人工智能的影响。 2014 年下半年人工智能. on AI) 会议成立。每隔 5 年,一个由 17 名成员组成的常务委员会由不仅学术界和研究机构,而且每个行业(特别是法律、政治、科学、政策和经济等)的具有 AI 专业知识的专家组成,我们正在预测和审视人工智能目前对大众的地位,人工智能在我们生活的各个领域所带来的变化和可能性,以及它的副作用。此外,它还旨在通过解释在现有人工智能技术应用领域的未来应用潜力,以及在可能引入人工智能的领域引入后的影响和担忧,帮助相关行业专家和政府决策。除了提供报告外,我们还开展活动以提前制定相关法律和制度。

2016年9月1日以【人工智能与生活2030】为主题,就业与工作、医疗健康、公共安全与保障、娱乐、教育、家居与服务机器人、交通运输等八大领域正在改变工作与生活. ,看着贫困地区。 【汇聚力量,汇聚风暴】是2019年两次研讨会讨论的内容,根据第一次报告发表后收到的反馈,在5年内聚合而成,报告每年在斯坦福大学AI100发表以人为本的人工智能研究院,第二份报告发布。

我们与读者分享其中最有趣的部分。

首先,它从一个问题开始:“我们在理解人类智能方面取得了多大进展?”

为了回答这个问题,专家们首先重新定义了人类智能。在人工智能研究的早期,人类智能仅作为人类信息处理能力的衡量标准(例如,如何解释和解决复杂问题,做出理性判断和快速决策)。其他用于理解意图和帮助我们的因素做出决定(例如情感上微妙的关系、态度、情绪和其他身体信号)也被认为是重要的指标。在这段话中,您可以看到智能的定义在过去五年中发生了变化。

报告提出了一个问题,“你认为最鼓舞人心和最具挑战性的任务是什么?”并询问人工智能专家正在关注什么。许多现有的人工智能研究和竞赛都专注于人工智能执行特定任务或达到基准。例如,我们专注于解决诸如基于格式良好的数据集提高准确性等问题。但是,如果看过去五年基于社会科学和人文学科的研究,相反,我们的研究方向是创造能够解决人类需求、达到最终目标、理解人类价值并理解人类价值的人工智能的最终目标。合作。这表明它离indirection更远了。

一个例子是人工智能基于种族和性别的偏见和歧视问题。产生这个问题的原因是我们只是为了提高数据集的准确率,以及数据的本质,即每个数据代表什么,质量是什么,每个错误意味着不同的人类价值观和不同的价值观. 他们说这是因为他们没有完全意识到它可能会产生后果。为了解决这个问题,计算机科学家、社会科学家和人文科学之间的合作是必要的。

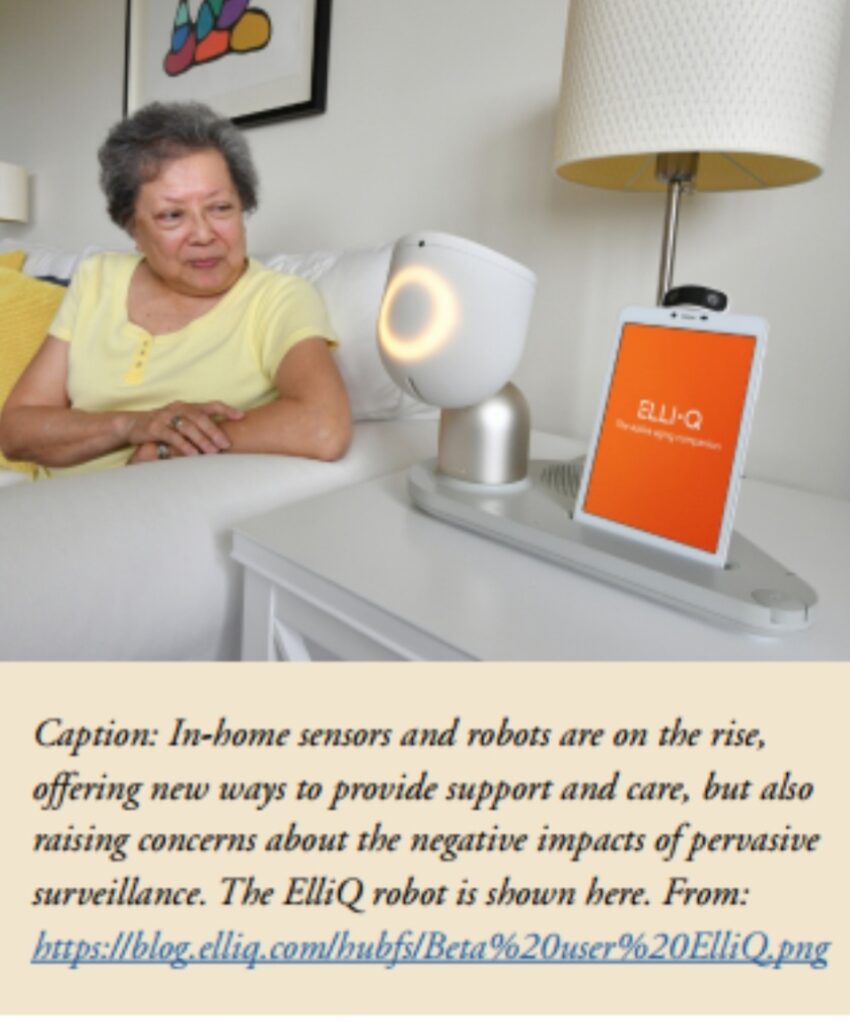

也可以结合图灵测试来考虑该主题。 1950 年,图灵测试测试了我们是否可以将真实女性与模仿女性的机器人区分开来,我们逐渐的目标是通过这项测试来了解机器人模仿人类的能力。然而,专家认为,今天的图灵测试还需要考虑欺骗机器人假装它在与真人交谈时可能出现的问题。例如,由于近年来人工智能的发展令人眼花缭乱,在社交媒体上也有因图像、视频、文字与人造版本无法区分而引起政治焦虑和混乱的案例。美国计算机科学家、哈佛大学自然科学教授芭芭拉·格罗兹 (Barbara Grosz) 也是为人与机器人之间的自然交流做出贡献的先驱,她在 2012 年也说过,“图灵今天会提出什么问题? (图灵今天会提出什么样的问题)”提到了这一点的重要性,并强调需要一种能够与人类自然交流而不会像人类一样欺骗他们的机器人。

作为这份报告(https://ai100.stanford.edu/2021-report/gathering-strength-gathering-storms-one-hundred-year-study-artificial-intelligence)的一部分,世界各地的人工智能专家这是一份报告这使我们能够了解当前的研究进展和未来研究的方向。总体而言,该报告认为人工智能可以帮助和补充人类,认为必须整合、尊重和维护这些关系。此外,强调人工智能的发展应该与社会科学方面有机地联系起来,而不仅仅是一种零碎的工程方法。本报告涵盖 12 个常设问题和 2 个研讨会问题。如果您想更详细地阅读世界级人工智能专家的观点,请参阅随附的报告。

AI100Report_MT_101