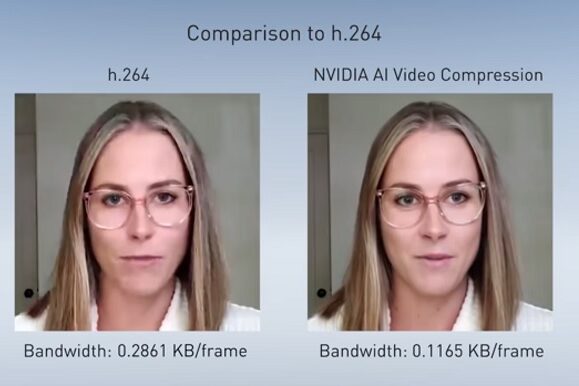

NVidia에서 Maxine이라는 클라우드 기반 화상 통신 플랫폼을 공개했습니다. Maxine의 특징은 AI 기술을 전면적으로 도입한 것인데, 구체적으로 얼굴 영상을 H.264와 같은 영상 코딩 기술로 압축해서 보내는 방식이 아니라 facial landmark를 detection하여 전송하고, 받는 쪽에서는 GAN을 이용해서 generation하는 방식으로 bandwidth를 H.264 대비 1/10으로 줄일 수 있었다고 합니다.

약 25년 전, 화상 통신 초기 시절 얼굴 모델 기반의 영상 압축 기술이 잠깐 등장했던 적이 있었는데, 상용 서비스에 걸맞는 충분한 화질을 얻을 수 없었고 화상 통신의 경우 필요 bandwidth가 많지 않아서 (움직임이 거의 없기 때문) 현재까지 영상의 각 픽셀들을 손실 압축하여 전송하는 방식이 사용되고 있습니다. 하지만, GAN 등 AI 기술이 발전하고 코로나19로 인해 화상 통신의 수요가 폭발적으로 증가하면서 bandwidth 감소는 또 다시 유의미한 요구 사항이 되었습니다. 다만, 실시간 facial landmark detection과 video generation에 요구되는 연산량(혹은 전력량)은 대부분 H/W로 처리되는 H.264 encoding/decoding에 비해 월등히 높기 때문에 이 부분을 어떻게 처리했는지 궁금해집니다. (네트워크 비용 vs. 부호화/복호화 비용)

Maxine은 얼굴 영상 전송 뿐 아니라 다른 기능들도 제공합니다. Human outline을 검출해서 배경을 임의로 설정하는 기능, 음성 인식과 번역을 결합한 실시간 다국어 대화, 잡음 제거, super resolution을 통한 화질 향상 등 최근 AI 분야에서 각각 등장했던 단위 기술들이 다수 포함되어 있습니다. 다양한 단위 기술들이 결합되어 하나의 서비스 형태를 갖추는 것을 목격하는 것은 언제나 즐거운 경험이네요^^