[서비스개발팀 조예지]

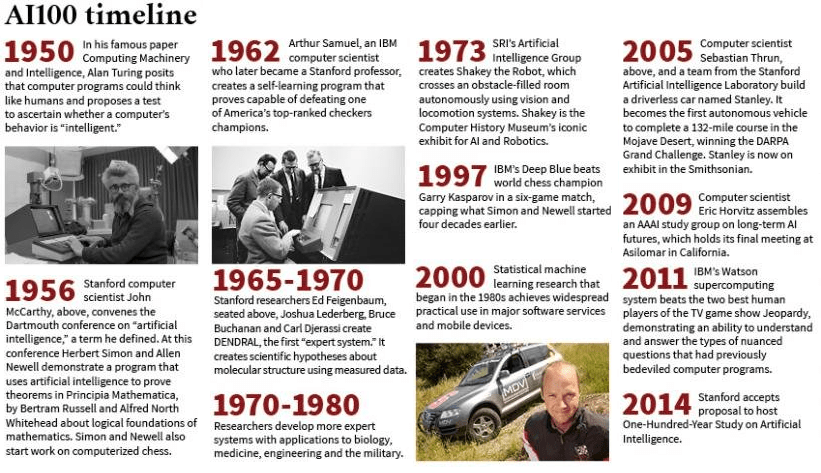

미국 내 인공지능을 연구하는 학회인 Association for the Advancement of Artificial Intelligence (AAAI)의 전 회장인 Eric Horvitz박사와 스탠포드 대학 컴퓨터 과학자들을 중심으로 2014년 하반기 인공지능의 영향력을 연구하는 AI100(One Hundred Year Study on AI) 모임이 창설되었습니다. 주기적으로 매 5년마다 학계, 연구소뿐만이 아닌 각 산업 (특히 법률, 정치, 과학, 정책 및 경제 등)분야의 AI 전문 지식을 갖춘 전문가들로 이루어진 17명인의 상임위원회가 구성되며, 이 연구 패널은 일반 대중에게 인공지능의 현 위치, 인공지능이 우리 삶의 각 영역에 끼치는 변화와 가능성 그리고 그 부작용에 대해 예측 및 검토하고 있습니다. 또한 기존 AI 기술이 적용된 분야에는 추후 활용 가능성을, 잠재적으로 AI를 도입하려는 분야에는 도입후에 따른 영향력 및 우려를 설명하여 관련 산업 전문가들과 정부의 의사 결정에 도움을 주는 것을 목표로 하고 있습니다. 또한 보고서 제공외에 관련 법과 제도를 미리 준비하는 활동을 펼치고 있습니다.

2016년 9월 1일 [2030년 인공지능과 삶]이라는 주제로 일과 삶을 변화시키는 주요 8가지 영역인 고용과 직장, 헬스케어, 공공 안전과 보안, 엔터테인먼트, 교육, 홈 및 서비스용 로봇, 교통, 빈곤 지역을 살펴보았습니다. 첫 리포트 발간 후 받은 피드백을 기반으로 주최했던 2019년 2번의 워크샾과 스탠포드대 Human-Centered Artificial Intelligence Institute내 AI100에서 매년 발간한 리포트에서 거론된 내용을 집약하여 5년만에 [Gathering Strength, Gathering Storms]라는 두번째 리포트를 발간하였습니다.

그 중 가장 흥미로웠던 부분을 독자들과 공유합니다.

먼저, “우리는 인간의 지능을 이해하는 데 얼마나 발전했는가”라는 질문으로 시작합니다.

이 질문을 답하기 위해 전문가들은 인간의 지능을 먼저 재정의합니다. AI를 연구하던 초기에는 인간의 지능을 인간의 정보 처리 능력이라는 척도로만 측정하였다면 (예를 들면 복잡한 문제를 어떻게 해석하고 해결하는가, 합리적인 판단과 빠른 결정을 내릴 수 있는가), 최근 많은 전문가들은 타인의 의도를 이해하고 우리의 의사 결정을 돕기 위해 쓰이는 그 외 요소들 (예를 들면 감정적으로 미묘한 관계, 태도, 감정 및 그 외 신체 신호들) 또한 중요한 척도라고 주장하고 있습니다. 지난 근 5년간 지능에 관한 정의가 변했음을 볼 수 있는 대목입니다.

그리고 해당 리포트는 “가장 영감을 주며 도전이 되는 과제는 무엇이라 생각하는가”라는 질문을 던지며 다수의 AI 전문가들이 주목하고 있는 분야를 묻고 있습니다. 기존의 많은 AI 연구와 대회들은 AI가 특정 임무를 수행하거나 벤치마크에 도달하는 것에 초점을 맞추었습니다. 예를 들면 잘 구성된 데이터셋을 기반으로 정확도를 향상시킨다든지 등의 문제를 해결하는 것에 초점 맞추었습니다. 그러나 지난 5년간의 사회과학과 인문학 기반의 리서치들을 살펴보면 오히려 이러한 우리의 연구 방향이 사람의 니즈를 해소하고, 궁극적인 목표에 도달하며, 사람의 가치관을 잘 이해하며 협력할 줄 아는 AI를 만들기 위한 궁극적인 방향성에서 더 멀어졌음을 보여주고 있었습니다.

한 예로 AI의 인종, 성별등의 편견과 차별 문제를 들 수가 있습니다. 이 문제가 기인된 이유는 우리가 데이터셋의 정확성 향상만을 목표로 삼았고, 해당 데이터의 본질, 즉 각 데이터가 무엇을 상징하며, 품질은 어떠한지, 각각의 오류가 각기 다른 인간의 가치를 의미하며 색다른 결과를 초래할 수 있음을 충분히 인지하지 못했기 때문이라고 말하고 있습니다. 이를 해결하기 위해서는 컴퓨터 공학자, 사회과학자, 인문학자간의 협업이 필요하다는 것입니다.

또한 해당 주제는 Turing Test도 연결지어서 생각해볼 수 있습니다. 1950년 Turing Test는 실제 여성과 여성을 흉내내는 봇을 구분할 수 있는 지를 테스트하였고, 점차 우리는 이 테스트로 봇이 얼마나 인간처럼 흉내낼 수 있는지를 목표화하게 되었습니다. 그러나 전문가들은 오늘날의 Turing Test에서 로봇을 마치 실제 인간과 대화하고 있는 것처럼 상대를 속이는 것으로 인해 발생될 수 있는 문제들을 고심할 필요도 있다고 주장하고 있습니다. 예를 들면 근래 AI의 눈부신 발전으로 인간이 만든 버전과 구분할 수 없는 이미지, 영상, 텍스트로 인해 SNS내 정치적인 불안과 혼돈을 야기한 사건도 있기 때문입니다. 미국 컴퓨터 과학자이자 Harvard University의 자연 과학 교수이자 인간과 봇의 자연스러운 의사소통에 공헌한 선구자인 Barbara Grosz 또한 2012년 “What Question Would Turing Pose Today? (Turing이라면 오늘날 어떤 질문을 제시했을까)”라는 논문에서 해당 중요성을 언급하였고, 사람인듯 속이지 않으면서 사람과 자연스러운 의사소통이 가능한 봇이 필요함을 강조하고 있습니다.

이 리포트의 일부분에서 보실 수 있듯이 (https://ai100.stanford.edu/2021-report/gathering-strength-gathering-storms-one-hundred-year-study-artificial-intelligence), AI 전문가들로부터 전세계 AI 연구의 현재 발자취와 앞으로의 연구 방향을 읽얼볼 수 있었던 리포트였습니다. 전체적으로 해당 리포트는 AI를 인간을 돕고 보완하는 존재로 보며, 이러한 관계는 서로 존중되고 유지된 채 통합되어야 한다고 주장하고 있습니다. 또한, AI의 발전은 단편적인 공학적인 접근만이 아닌 사회과학적인 측면과 유기적인 관계를 이루어야 한다고 강조하고 있습니다. 해당 리포트안에 12개의 Standing Questions와 2개의 Workshop Questions를 다루고 있습니다. 세계적인 AI 전문가들의 견해를 더 자세히 읽고 싶으시다면 첨부한 리포트를 참고하시기 바랍니다.

AI100Report_MT_101