[융합연구팀 황준선]

AI 기술은 비약적으로 발전해왔고, 우리는 많은 편의성을 제공 받고 있다. 심지어 이 AI 기술 분야 중에선 전력량을 예측하거나 탄소배출량 등을 예측하여 보다 효율적으로 에너지를 사용하거나 비축할 수 있도록 도와주는 분야도 존재한다. 하지만, 이 AI 시스템이 제대로된 성능을 발휘하기 위해서 AI 모델을 학습시키고 테스트하는 과정이 필요하다. 이러한 일련의 과정에서 발생하는 에너지 소모량은 많이 고려되어 오지 않았다. 에너지를 절약하기 위해서 개발한 친환경적인 AI 시스템을 구축할 때, 학습 과정에서 발생시키는 AI 모델의 에너지 소모량이 에너지 절약양보다 많다면?

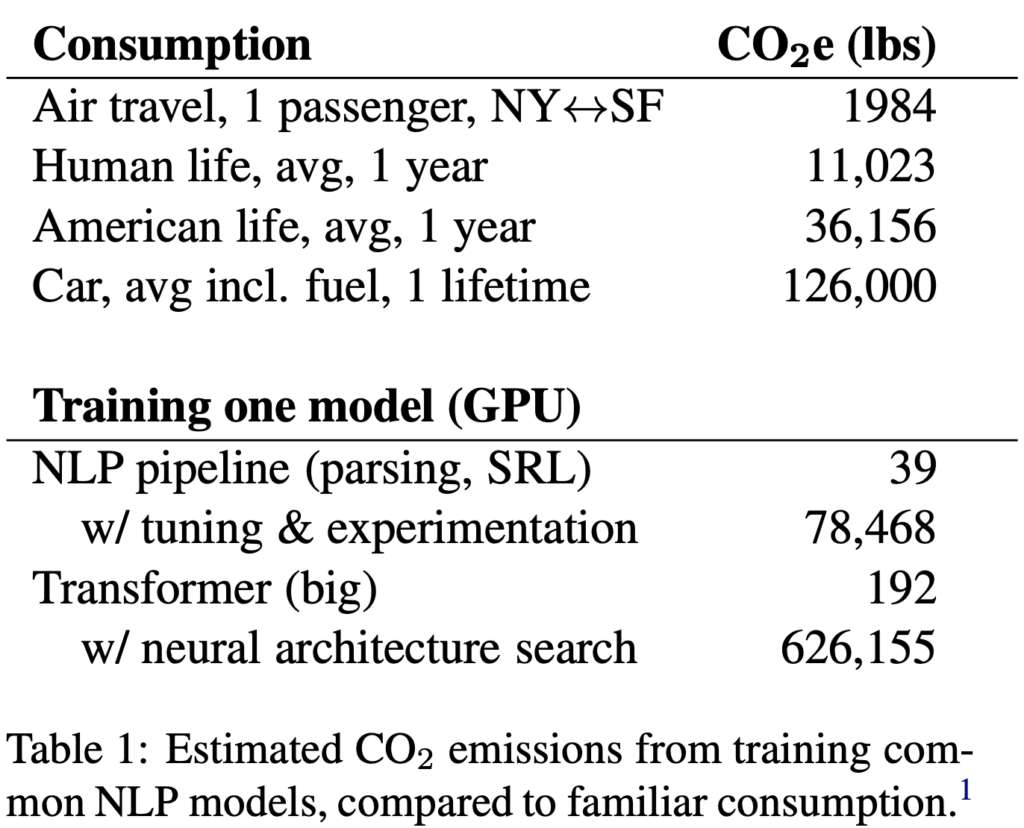

위 표[1]는 NLP 관련 실험의 이산화탄소 발생량을 친숙한 대조군과 비교 측정한 것이다. 1개의 Transformer를 학습할 때 발생하는 이산화탄소 배출량은 차량 한대가 평생 발생시키는 것의 약 5배에 이른다는 실험 결과이다.

IT를 대표하는 세계적인 기업들인 구글, 애플, 마이크로소프트 등이 탄소 제로 또는 탄소 중립 경영에 힘쓰고 있는 추세이다. 테슬라 또한 전기자동차 개발에 힘쓰며 탄소 배출량을 현저하게 줄이는 것에 기여하고 있다. 그러던 중 구글 AI Ethics 팀의 Timnit Gebru 박사는 2020년에 구글의 핵심 NLP 모델 중 하나인 BERT가 과도하게 이산화탄소를 배출하고 있다는 논문을 투고해 화제가 된적이 있었다. 이 외에도 AI 모델 학습이 환경에 미치는 영향력을 연구하는 논문[2]들이 많이 발표 되고 있다.

RED AI

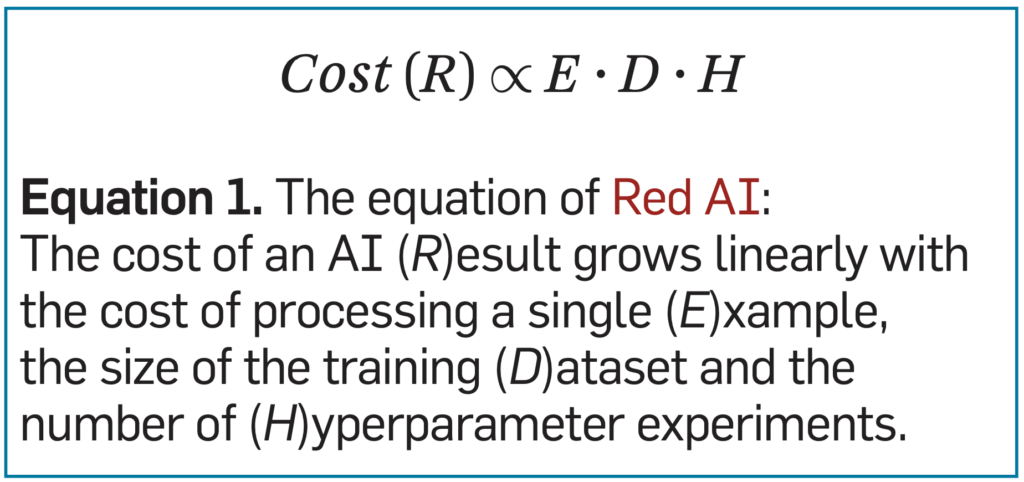

Red AI는 여러 비용을 무시하고 막대한 계산 능력을 사용하여 정확성을 개선하는, 본질적으로 더 강력한 성능과 결과를 “구매”하여 개선하려는 AI 연구를 말한다.[2]

AI 시스템의 비용은 위와 같은 식으로 표현이 가능하다. 우리가 흔히 알고 있듯, 모델의 크키가 커질수록, 데이터가 많아질 수록, 하이퍼파라미터 조정을 섬세하게 할수록 모델의 성능은 커지게 된다. 하지만 이 모든 것이 전력 소모량에 비례하는 것도 사실이다.

GREEN AI

Red AI와 대척점에 있는 개념이 Green AI이다. AI가 환경에 미치는 영향을 무시할 수 없는 수준이라고 인식하고, 친환경적인 AI 연구를 지향하는 개념이다. 비슷한 성능을 유지하면서 연산량 또는 모델의 파라미터 수를 줄이는 Model Compression 등을 포함하여, 더 넓은 의미로 효율적인 Data management, querying 등을 포함한다. 현재도 mobile embedded system 등을 위한 경량 모델을 개발하는 것이 활발하지만, 단순히 경량 모델을 개발하기 위해서가 아닌 친환경적인 측면에서도 이러한 연구에 더 힘을 실어야한다고 생각한다.

자동차는 편의성 때문에 대중적인 이동수단이 되었다. 그럼에도 자동차 등장부터 지금까지 환경 파괴 이슈는 끊이지 않는다. AI 기술도 발전을 거듭하여 대중화되고 있으며, 우리의 편의성을 크게 높여주는 기술이 되어가는 중이다. 하지만 AI 시스템의 몸집이 점점 커지고 많은 연산량이 필요해진 지금, 자동차와 마찬가지로 환경 파괴 이슈를 불러오고 있다. 더 많은 리소스가 투자되면 더 좋은 AI 성능을 가져올 수 있다는 것을 모두 알고 있을 것이다. 하지만 본문 첫부분에 언급했던 것처럼 환경 보호를 위해 만들어지는 AI 시스템이 소모하는 전력량과 탄소배출량이 더 많아지는 역전된 상황이 되지 않길 바란다. 우리나라도 2050년 탄소 중립을 선언한 만큼, AI 기술 연구에도 환경 보호를 위한 설계가 필요하다고 생각한다.

[1] STRUBELL, Emma; GANESH, Ananya; MCCALLUM, Andrew. Energy and policy considerations for deep learning in NLP. arXiv preprint arXiv:1906.02243, 2019.

[2] SCHWARTZ, Roy, et al. Green ai. Communications of the ACM, 2020, 63.12: 54-63.